El quark y el jaguar

Murray Gell-Mann

Para Marcia

Es bueno para nosotros, el caos y el color, quiero decir.

Marcia Southwick, Why the River Disappears

El quark y el jaguar no es una autobiografía, aunque de hecho contiene recuerdos de mi infancia y anécdotas sobre colegas científicos. Tampoco trata de mi trabajo en el campo de los quarks, pese a que gran parte del libro está dedicada a reflexiones sobre las leyes fundamentales de la física, incluido el comportamiento de dichas partículas. Espero escribir algún día una autobiografía científica, pero el propósito en este volumen es presentar al lector mi propia visión sobre una síntesis que está emergiendo en los límites de la investigación acerca de la naturaleza del mundo que nos rodea: el estudio de lo simple y lo complejo. Este estudio está empezando a reunir, con una nueva perspectiva, material procedente de muy diversos campos de las ciencias físicas, biológicas y del comportamiento, e incluso de las artes y humanidades. El enfoque que conlleva facilita el descubrimiento de conexiones, en ocasiones entre hechos o ideas que a simple vista parecen muy alejados entre sí. Más aún, está empezando a dar respuesta a algunas de las preguntas que muchos de nosotros, científicos o no, continuamos haciéndonos sobre el verdadero significado de lo simple y lo complejo.

Este libro está dividido en cuatro partes. En la primera, comienzo refiriendo algunas experiencias personales que me condujeron a escribirlo. Dando largos paseos por las selvas tropicales, estudiando los pájaros y planeando actividades conservacionistas, comenzó a tomar cuerpo en mí la idea de compartir con los lectores mi creciente conciencia de los vínculos entre las leyes fundamentales de la física y el mundo que vemos a nuestro alrededor. Durante toda mi vida me ha apasionado explorar el reino de los seres vivos, aunque mi dedicación profesional ha estado principalmente orientada hacia la investigación de las leyes fundamentales. Estas leyes, subyacentes a toda ciencia (en un sentido que se discutirá en las páginas que siguen), a menudo parecen completamente ajenas a la experiencia, incluyendo gran parte de la propia de otras ciencias distintas de la física. Al reflexionar sobre cuestiones relacionadas con lo simple y lo complejo percibimos conexiones que nos permiten establecer vínculos entre todos los fenómenos de la naturaleza, desde los más sencillos a los más complicados.

Cuando mi esposa me leyó el poema de Arthur Sze donde menciona el quark y el jaguar, me chocó de inmediato lo bien que ambas imágenes se ajustaban a lo que yo quería tratar. Los quarks son los ladrillos básicos que componen toda la materia. Todo objeto que vemos está constituido de quarks y electrones. Incluso el jaguar, ese antiguo símbolo de fuerza y ferocidad, es un manojo de quarks y electrones, ¡pero qué manojo! Exhibe una enorme complejidad, resultado de miles de millones de años de evolución biológica. Sin embargo, ¿qué significa exactamente la complejidad en este contexto, y cómo surgió? Esta es la clase de cuestiones que este libro trata de responder.

El resto de la primera parte está dedicado a las relaciones entre conceptos diversos de simplicidad y complejidad, así como a los sistemas complejos adaptativos —aquellos que aprenden o evolucionan del mismo modo que lo hacen los seres vivos—. Un niño que aprende su lengua materna, una bacteria que desarrolla resistencia a los antibióticos y la empresa científica humana son ejemplos de sistema complejo adaptativo que se discuten. También se discute el papel de la teoría en la ciencia, así como el problema de cuáles son las ciencias más fundamentales, junto con la cuestión relacionada de lo que se entiende por reduccionismo.

La segunda parte trata de las leyes fundamentales de la física, aquellas que gobiernan el cosmos y las partículas elementales a partir de las cuales se compone toda la materia del universo. Aparecen aquí por derecho propio los quarks, así como las supercuerdas, que ofrecen por primera vez en la historia una seria posibilidad de teoría unificada de todas las partículas e interacciones de la naturaleza. La teoría de las partículas elementales es tan abstracta que mucha gente encuentra difícil seguirla incluso cuando, como aquí, se la explica sin recurrir a las matemáticas. Para algunos lectores quizá sea aconsejable saltarse estas secciones, especialmente los capítulos 11 (sobre la interpretación moderna de la mecánica cuántica) y 13 (sobre el modelo estándar de las partículas elementales, quarks incluidos). La no lectura de estos capítulos, o incluso de toda la segunda parte, no impide el seguimiento de las partes restantes. Resulta irónico que una parte del libro consagrada a explicar por qué las teorías físicas fundamentales son simples, pueda resultar, sin embargo, demasiado difícil para muchos lectores. ¡Mea culpa! Esta segunda parte concluye con un capítulo sobre la flecha o flechas del tiempo, y culmina con un comentario acerca de por qué siguen apareciendo más y más estructuras complejas, ya sean sistemas complejos adaptativos, como la evolución biológica, ya sean sistemas no adaptativos, como las galaxias.

La tercera parte recoge las presiones selectivas que actúan sobre los sistemas complejos adaptativos, especialmente en la evolución biológica, el pensamiento creativo humano, el pensamiento crítico y supersticioso y algunos aspectos (incluidos los económicos) del comportamiento de las sociedades humanas. Se introducen las nociones, imprecisas aunque convenientes, de adaptación y relieve adaptativo. En el capítulo 20 describo brevemente el uso de los ordenadores como sistemas complejos adaptativos, por ejemplo para desarrollar estrategias en ciertos juegos o para proporcionar simulaciones simplificadas de sistemas complejos adaptativos naturales.

La última parte difiere bastante del resto, pues se centra más en asuntos de política y legislación. El capítulo 21 prosigue la discusión precedente sobre la diversidad de la vida en la Tierra como representación de la información destilada a lo largo de cuatro mil millones de años de evolución biológica, así como la diversidad cultural del hombre representa lo mismo en relación con las decenas de miles de años de evolución cultural del Homo sapiens sapiens. En este capítulo argumento que merece la pena dedicar un gran esfuerzo a preservar tanto la diversidad biológica como la cultural, y señalo algunos de los desafíos, problemas y paradojas implicados. Pero no es posible considerar todos estos aspectos por separado. En la actualidad, la red de interrelaciones que conecta el género humano consigo mismo y con el resto de la biosfera es tan compleja que todos los aspectos se influyen mutuamente en grado extremo. Alguien debería estudiar el sistema en su totalidad, aunque sea toscamente, porque la suma de los estudios parciales de un sistema complejo no lineal no puede dar idea del comportamiento del todo. El capítulo 22 describe algunos de los esfuerzos que empiezan a desarrollarse para llevar a cabo un estudio tal de los problemas mundiales que incluya todos los aspectos relevantes, y no sólo los medioambientales, demográficos o económicos, sino también los sociales, políticos, militares, diplomáticos e ideológicos. El objeto de este estudio no es especular sobre el futuro, sino tratar de identificar, entre las múltiples alternativas de futuro razonablemente probables que se le plantean al género humano y al resto de la biosfera, cuáles son aquellas que podrían conducir a una mayor sostenibilidad. La palabra sostenibilidad se emplea aquí en un sentido amplio, que no sólo implica evitar las catástrofes medioambientales, sino también las guerras devastadoras, la propagación de las tiranías permanentes y otros males mayores.

El lector encontrará en este volumen muchas referencias al Instituto de Santa Fe, en cuya fundación colaboré y en el cual trabajo ahora después de retirarme del Instituto Tecnológico de California. En este último soy en la actualidad profesor emérito tras haber enseñado allí durante más de treinta y ocho años. Una buena parte de la investigación que hoy se lleva a cabo sobre la simplicidad, la complejidad y los sistemas complejos adaptativos la efectúan miembros del Instituto o, para ser más exactos, de la familia del Instituto.

Resulta apropiada la palabra familia, porque el Instituto de Santa Fe es una organización bastante poco rígida. El presidente, Edward Knapp, está asistido por dos vicepresidentes y una plantilla de personal administrativo compuesta por una docena de trabajadores de gran dedicación. Solamente hay tres catedráticos, yo entre ellos, todos con cinco años de antigüedad. Cualquiera puede ser visitante, con una estancia entre un día y un año. Los visitantes vienen de todas partes del mundo, algunos de ellos con cierta frecuencia. El Instituto organiza numerosos cursillos, que duran desde unos pocos días hasta semanas. Además, se han establecido varias redes de investigación sobre diversos temas interdisciplinarios. Los miembros de estas redes se comunican entre sí por teléfono, correo electrónico, fax y ocasionalmente por correo ordinario, y se reúnen periódicamente en Santa Fe o en otro lugar. Hay expertos en decenas de especialidades, todos interesados en colaborar por encima de las fronteras disciplinarias. Cada uno de ellos trabaja en su propia institución, donde lleva a cabo satisfactoriamente sus investigaciones, pero todos valoran su afiliación a Santa Fe porque les permite establecer contactos que de otra manera resultarían menos fáciles. Las instituciones de procedencia pueden ser grandes laboratorios industriales, universidades o laboratorios nacionales (especialmente el de Los Alamos, que ha suministrado al Instituto tantos miembros brillantes y activos).

Quienes se dedican a estudiar sistemas complejos adaptativos comienzan ya a encontrar algunos principios generales subyacentes en este tipo de sistemas; la búsqueda de estos principios requiere intensas discusiones y colaboraciones entre especialistas de muchas áreas. Por descontado, el estudio meticuloso e inspirado de cada especialidad sigue siendo tan vital como siempre, pero la integración de las diferentes especialidades es también una necesidad urgente. El puñado de expertos y científicos especialistas que se están convirtiendo en estudiosos de la simplicidad y la complejidad, o de los sistemas complejos adaptativos en general, ha realizado ya importantes contribuciones científicas.

El éxito de esta transición se halla asociado a menudo con cierto estilo de pensamiento. Nietzsche introdujo la distinción entre «apolíneos», aquéllos que dan preferencia a la lógica, la aproximación analítica y el peso desapasionado de la evidencia, y «dionisíacos», aquéllos más inclinados a la intuición, la síntesis y la pasión. Estos rasgos se suelen correlacionar de forma burda con el uso preferente de los hemisferios cerebrales izquierdo y derecho, respectivamente. Algunos de nosotros parecemos pertenecer a otra categoría: los «odiséicos», que combinan las dos predilecciones en su búsqueda de conexiones entre las ideas. La gente así suele sentirse sola en las instituciones convencionales, pero encuentran un ambiente particularmente agradable en el Instituto de Santa Fe.

Las especialidades representadas en el centro incluyen las matemáticas, la informática, la física, la química, la biología de poblaciones, la ecología, la biología evolutiva, la biología del desarrollo, la inmunología, la arqueología, la lingüística, las ciencias políticas, la economía y la historia. El Instituto también convoca seminarios y publica memorias científicas sobre temas tan dispares como la propagación de la epidemia del SIDA, las oleadas migratorias de los pueblos prehistóricos del sudoeste de los Estados Unidos, las estrategias de recolección de las colonias de hormigas, cómo se puede ganar dinero aprovechando aspectos no aleatorios de las fluctuaciones de precios en los mercados financieros, qué les sucede a las comunidades ecológicas cuando desaparecen especies importantes, cómo programar ordenadores para simular la evolución biológica y cómo gobierna la mecánica cuántica el mundo familiar que vemos a nuestro alrededor.

El Instituto de Santa Fe colabora también con otras organizaciones en el intento, descrito en el capítulo 22, de modelar las vías a través de las cuales la sociedad humana de nuestro planeta puede evolucionar hacia esquemas más sostenibles de interacción consigo misma y con el resto de la biosfera. Aquí resulta especialmente necesario superar la idea dominante en los círculos académicos y burocráticos de que sólo merece la pena dedicarse seriamente a investigaciones altamente detalladas en el seno de una especialidad. Hay que valorar las contribuciones igualmente fundamentales de aquellos que se atreven a dar lo que yo llamo «un vistazo a la totalidad».

Aunque el Instituto de Santa Fe es uno de los poquísimos centros científicos del mundo dedicados exclusivamente al estudio de lo simple y lo complejo en una gran variedad de campos, no es de ninguna manera el único lugar —ni siquiera el principal— donde se llevan a cabo investigaciones importantes sobre estos temas. Muchos de los proyectos específicos del Instituto tienen paralelos en otras partes del mundo y, en muchos casos, la investigación relevante comenzó anteriormente en otras instituciones, a menudo antes de que este centro fuera fundado en 1984. En algunos casos, esas instituciones son la base de operaciones de miembros clave de la familia del Instituto.

En este punto debería disculparme por lo que debe parecer una especie de campaña publicitaria, especialmente porque la naturaleza de la relación entre el Instituto y otras organizaciones científicas y docentes ha aparecido algo distorsionada en ciertos libros publicados por autores científicos en los últimos años. La glorificación del Santa Fe a expensas de otros lugares ha indignado a muchos de nuestros colegas, especialmente en Europa. Pido excusas por adelantado si mi libro diera una impresión igualmente equivocada. La única razón de mi insistencia en Santa Fe es que estoy familiarizado con buena parte del trabajo que se lleva a cabo aquí, o con el que realizan los estudiantes y científicos que nos visitan, y conozco más bien poco de la investigación que se desarrolla en otros lugares.

En cualquier caso, citaré (sin ningún orden particular) algunas de las instituciones punteras donde se realizan, o se han estado realizando durante muchos años, investigaciones relevantes sobre aspectos relacionados con la simplicidad, la complejidad y los sistemas complejos adaptativos. Naturalmente, al hacer esto corro el riesgo de exacerbar la ira de los científicos y estudiosos pertenecientes a los centros que no he incluido en esta lista parcial: La École Nórmale Superieure de París; el Instituto Max Planck de Química Biofísica en Göttingen, cuyo director es Manfred Eigen; el Instituto de Química Teórica de Viena, antes dirigido por Peter Schuster, actualmente embarcado en la fundación de un nuevo instituto en Jena; la Universidad de Michigan, donde Arthur Burks, Robert Axelrod, Michael Cohen y John Holland forman el «grupo BACH», un equipo interdisciplinario que durante mucho tiempo ha trabajado en problemas relacionados con sistemas complejos, todos ellos conectados en algún grado con el Instituto de Santa Fe, especialmente John Holland, miembro, al igual que yo, del consejo científico; la Universidad de Stuttgart, donde Hermann Haken y sus colaboradores se dedican desde hace tiempo al estudio de los sistemas complejos en las ciencias físicas bajo la denominación de «sinergética»; la Universidad Libre de Bruselas, donde se han llevado a cabo importantes aportaciones durante muchos años; la Universidad de Utrech; el Departamento de Ciencias Puras y Aplicadas de la Universidad de Tokio; el ATR, cerca de Kyoto, adonde se ha ido Thomas Ray, antes en la Universidad de Delaware; los centros para el estudio de sistemas no lineales en varios campus de la Universidad de California, entre ellos los de Santa Cruz, Berkeley y Davis; la Universidad de Arizona; el Centro para la Investigación de Sistemas Complejos, del Instituto Beckman, adscrito a la Universidad de Illinois en Urbana; el programa de computación y redes neuronales del Instituto Beckman, adscrito al Instituto Tecnológico de California; la Universidad Chalmers, en Goteburgo; el NORDITA, en Copenhague; el Instituto Internacional para el Análisis Aplicado de Sistemas, en Viena, y el Instituto para el Intercambio Científico, en Turín.

Algunos amigos y colegas, cuyo trabajo respeto profundamente, han tenido la amabilidad de revisar todo el manuscrito en varias fases de su elaboración. Estoy muy agradecido por su ayuda, que me ha resultado inmensamente valiosa, aunque, debido a las premuras de tiempo, sólo he podido aprovechar una fracción de sus excelentes sugerencias. Ellos son Charles Bennet, John Casti, George Johnson, Rick Lipkin, Seth Lloyd, Cornac McCarthy, Harold Morowitz y Cari Sagan. Además, un puñado de distinguidos expertos en diversos campos me ha regalado su tiempo accediendo a revisar pasajes particulares del manuscrito; quiero mencionar a Brian Arthur, James Brown, James Crutchfield, Marcus Feldman, John Fitzpatrick, Walter Gilbert, James Hartle, Joseph Kirschvink, Christopher Langton, Benoit Mandelbrot, Charles A. Munn III, Thomas Ray, J. William Schopf, John Schwarz y Roger Shepard. Naturalmente, los errores que puedan persistir son de mi única responsabilidad, y no son atribuibles a ninguna de estas personas sabias y amables.

Cualquiera que me conozca sabe de mi aversión a los errores, que se manifiesta, por ejemplo, en mi incesante corrección de palabras francesas, italianas y españolas en los menús de los restaurantes americanos. Cuando descubro una inexactitud en un libro escrito por cualquier otro, me invade la decepción y me pregunto si en verdad podré aprender algo de un autor que ha demostrado estar equivocado como mínimo en un punto. Cuando los errores me conciernen a mí o a mi trabajo, me pongo furioso. Así pues, el lector de este volumen se podrá hacer fácilmente una idea de la turbación que estoy padeciendo al imaginarme decenas de errores graves descubiertos por mis amigos y colegas tras la publicación, y señalados, con soma o pena, a este autor tan perfeccionista. Además, no dejo de pensar en el personaje imaginario que me describió Robert Fox (un autor especializado en el problema de la población): un vigilante de faro noruego que no tenía otra cosa que hacer en las largas noches de invierno que leer nuestros libros en busca de errores.

Quisiera expresar mi especial gratitud a mi diestra y fiel asistente, Diane Lams, por toda la ayuda que me ha prestado en el proceso de acabado y edición del libro, por resolver mis asuntos de forma tan competente, lo que me permitió dedicar el suficiente tiempo y energía al proyecto y, en especial, por sobrellevar el mal carácter que muestro frecuentemente a la vista de plazos límite.

Los editores, W.H. Freeman and Company, han sido muy comprensivos con mis dificultades a la hora de cumplir plazos, y me proporcionaron un maravilloso jefe de edición, Jerry Lyons (ahora en Springer-Verlag), con quien ha sido una delicia trabajar. Quisiera agradecerle no sólo sus esfuerzos, sino también su buen humor y afabilidad, y los muy buenos momentos que Marcia y yo hemos pasado con él y su maravillosa esposa, Lucky. Mi gratitud se extiende también a Sara Yoo, quien trabajó incansablemente distribuyendo copias y revisiones a editores impacientes de todo el mundo. Liesl Gibson merece mi agradecimiento por su cortés y muy eficiente asistencia con las exigencias de última hora en la preparación del manuscrito.

Es un placer reconocer la hospitalidad de las cuatro instituciones a las que he estado ligado mientras escribía este libro: Caltech[1], el Instituto de Santa Fe, el Centro Aspen de Física y el Laboratorio Nacional de Los Alamos. Quisiera mostrar mi agradecimiento a la Fundación Alfred P. Sloan y a las agencias gubernamentales estadounidenses que han financiado mi investigación en los últimos años: el Departamento de Energía y la Oficina de Investigación Científica de la Fuerza Aérea. (A algunos lectores les puede sorprender el hecho de que estas agencias financien investigaciones que, como la mía, no están clasificadas como militares ni tienen conexión con las armas. La ayuda otorgada a la ciencia pura por estas organizaciones es una buena prueba de su clarividencia.) También agradezco profundamente la donación de Jeffrey Epstein al Instituto de Santa Fe para apoyar mi trabajo.

En Los Alamos me trataron muy amablemente el director del laboratorio. Sig Hecker, el director de la división teórica, Richard Slansky, y el secretario de la división. Stevie Wilds. En el Instituto de Santa Fe, cada miembro de la administración y del personal ha sido de lo más servicial. En Caltech, el presidente, el rector y los miembros entrantes y salientes de la división de física, matemáticas y astronomía, han sido todos ellos muy amables, así como John Schwarz y esa maravillosa dama que ha sido la secretaria del grupo de teoría de partículas elementales durante más de veinte años. Hclen Tuck. En el Centro Aspen de Física todo ha orbitado desde su fundación hace más de treinta años en torno a Sally Mencimer, y quisiera agradecerle también a ella sus muchas amabilidades.

Escribir nunca me ha resultado fácil, probablemente debido a que siendo niño mi padre criticaba con vehemencia cualquier cosa que yo redactase. El que yo fuese capaz de completar este proyecto hay que debérselo a mi amada esposa Marcia, que me inspiró y espoleó para perseverar en el trabajo. Su contribución fue indispensable también en otros aspectos. Como poetisa y profesora de inglés, fue capaz de curar mis peores hábitos lingüísticos, aunque desafortunadamente aún restan muchas imperfecciones de estilo que por supuesto, no hay que achacarle. Me persuadió para trabajar con un ordenador, del cual me he convertido en un adicto: ahora me parece extraño haber pensado alguna vez en pasar sin uno. Además, tratándose ella de una persona con poco bagaje científico o matemático, pero con un profundo interés en ambas disciplinas, ha sido el banco de pruebas ideal para este libro.

En mi labor de profesor y conferenciante, a menudo me han aconsejado elegir a alguien de la audiencia y dirigir la charla a esa persona en particular, tratando incluso de establecer contacto visual repetido con ella. En cierto sentido, eso es lo que he hecho aquí. Este libro está destinado a Marcia que me indicó incansablemente los sitios donde las explicaciones eran insuficientes o las discusiones excesivamente abstractas. He cambiado partes del manuscrito una y otra vez hasta que ella las comprendió y dio el visto bueno. Como en muchos otros aspectos, disponer de más tiempo me hubiera ayudado. Todavía hay, lamentablemente, ciertos pasajes en los que ella hubiese deseado una mayor claridad.

Mientras daba los toques finales que me permitían los plazos límite, me di cuenta de que nunca en mi vida había trabajado tan intensamente. La investigación en física teórica es completamente distinta. Naturalmente, un físico teórico piensa y ejerce muchísimo en horas intempestivas, sea o no consciente de ello. Pero unas pocas horas de reflexión o de cálculo, cada día o cada pocos días, más una buena cantidad de discusiones con colegas y estudiantes, junto con el tiempo dedicado al trabajo explícito en el escritorio o en la pizarra, suelen ser suficientes. Escribir, por contra, significa invertir un buen número de horas frente al teclado prácticamente cada día. Para una persona fundamentalmente perezosa como yo, ello ha representado una auténtica conmoción.

Lo más apasionante de haber escrito un libro como éste es la conciencia de que el propio proyecto era en sí mismo un sistema complejo adaptativo. En cada fase de su composición, tenía un modelo mental (o esquema) para el conjunto, un resumen conciso de lo que pretendía ser. Para producir un capítulo o una parte, este resumen tenía que revestirse de gran cantidad de detalles. Después, mi editor, mis amigos y colegas, y finalmente Marcia y yo mismo, examinábamos lo escrito, y los comentarios y críticas resultantes no sólo afectaban al texto de aquel capítulo, sino al propio modelo mental, propiciando a veces su sustitución por otro. Cuando se añadían detalles al nuevo modelo para producir más texto, se repetía el mismo proceso. De esta manera el concepto de la totalidad del trabajo continuaba evolucionando.

El resultado de este proceso evolutivo es el libro que el lector está a punto de leer. Espero que consiga comunicar algunas de las emociones que experimentamos los que nos dedicamos a pensar en la cadena de relaciones que enlazan el quark con el jaguar y con los propios seres humanos.

Parte I

Lo simple y lo complejo

Prólogo

Un encuentro en la jungla

En primer lugar, tengo que decir que nunca he visto un jaguar en libertad. Después de mucho caminar por las selvas tropicales y navegar por los ríos de América Central y del Sur, nunca he vivido la emocionante experiencia de encontrarme de repente ante el enorme y poderoso felino moteado. No obstante, algunos de mis amigos me han contado cómo el encuentro con un jaguar puede hacerle cambiar a uno la manera de ver del mundo.

Lo más cerca que he estado de conseguirlo fue en las selvas de las tierras bajas orientales del Ecuador, cerca del río Ñapo, un afluente del Amazonas, en el año 1985. En esta región se han asentado indios montañeses de habla quechua, la lengua del antiguo imperio inca. Aquí han aclarado pequeñas parcelas en medio de la jungla donde practican la agricultura y han bautizado con sus propios nombres algunos de los accidentes naturales del relieve amazónico.

Sobrevolando estas tierras, que se extienden miles de kilómetros en todas las direcciones, los ríos parecen bandas sinuosas serpenteando por la selva. A menudo los meandros se separan paulatinamente de la corriente principal originando lo que los geólogos llaman meandros abandonados, lagunas cuya única conexión con la corriente principal es un delgado hilo de agua. Los hispanohablantes de la región las llaman cochas, término quechua que se aplica también a los lagos elevados y al mar. Desde el aire pueden observarse todos los estadios del proceso: los meandros originales, las cochas recientes y, por último, la lenta desecación de las mismas, reclamadas para el bosque por una secuencia de especies vegetales que constituye una auténtica «sucesión ecológica». Finalmente se ven desde el aire como manchas de color verde claro sobre el verde más oscuro de la selva circundante, manchas que, al cabo de uno o varios siglos, acaban difuminándose.

El día que estuve a punto de ver un jaguar me encontraba en un sendero cerca de Paña Cocha, que significa «lago de las pirañas». En este lugar mis compañeros y yo habíamos pescado y cocinado otras veces pirañas de hasta tres especies, todas ellas exquisitas. Estos peces no son tan peligrosos como suele creerse. Es cierto que a veces atacan a la gente y que, si un bañista resulta mordido por alguno de ellos, es mejor que abandone el agua para que la sangre no atraiga a otros. Pero la verdad es que, cuando tropiezan con nosotros, lo más probable es que sean ellos los que acaben siendo devorados.

A una hora de camino del lago ahuyentamos un grupo de pecarís y, de inmediato, percibimos la presencia de otro gran mamífero ante nosotros. Había un intenso olor acre, muy diferente del de los cerdos salvajes, y se oían los crujidos de una criatura grande y pesada atravesando la maleza. Apenas pude entrever la punta de la cola antes de que desapareciera. El rey de los animales, el emblema del poder de sumos sacerdotes y gobernantes, había pasado de largo.

Pero no sería un jaguar, sino otro felino más pequeño, el que iba a tener una importancia vital para mí al hacerme ver hasta qué punto muchos de mis intereses en apariencia inconexos estaban en realidad ligados. Ocurrió cuatro años después del incidente en Ecuador, mientras me hallaba realizando estudios de campo sobre la flora y la fauna en otra área selvática de la América tropical, lejos de los antiguos dominios de los incas. En aquella región había florecido en el pasado otra gran civilización precolombina: la de los mayas. Me encontraba al noroeste de Belice, cerca de las fronteras guatemalteca y mejicana, en un lugar llamado Chan Chich, que significa «pequeño pájaro» en el dialecto maya local.

Todavía hoy se habla la lengua maya en esta parte de Centroamérica, y pueden encontrarse por doquier huellas de la civilización maya clásica, las más notables de las cuales son las ruinas de ciudades abandonadas. Una de las mayores es Tikal, con sus gigantescas pirámides y templos, situada en el extremo nororiental de Guatemala, a poco más de cien kilómetros de Chan Chich.

Las especulaciones sobre el derrumbamiento de la civilización maya, ocurrido hace más de mil años, son abundantes, pero las auténticas causas constituyen todavía hoy un misterio y una fuente de controversias. ¿Se cansó el pueblo llano de trabajar en beneficio de nobles y gobernantes? ¿Perdieron la fe en el elaborado sistema religioso que sostenía a la élite en el poder y mantenía intacto el entramado social? ¿Les llevaron a la catástrofe las guerras intestinas entre las múltiples ciudades-Estado? ¿Fracasaron finalmente las notables técnicas agrícolas que mantenían a tan vastas poblaciones en plena selva? Los arqueólogos continúan buscando respuesta a éstas y otras preguntas, considerando al mismo tiempo la relación entre el hundimiento definitivo de la civilización clásica en la selva y lo sucedido en las regiones más áridas del Yucatán, donde la civilización clásica dio paso a la civilización postclásica, de influencia tolteca.

Naturalmente, la visita a unas excavaciones tan imponentes como las de Tikal es inolvidable, pero la jungla brinda otros placeres a aquellos que ansían explorar terrenos menos conocidos. Uno de ellos es el descubrimiento inesperado de alguna de las muchas ruinas no señaladas en los mapas.

En la distancia, las ruinas parecen montículos cubiertos de árboles y arbustos en medio de la jungla, pero al mirar más de cerca se adivinan las antiguas construcciones cubiertas de musgo, helechos y enredaderas. Escudriñando entre el follaje uno puede hacerse idea de la forma y dimensiones del lugar, especialmente desde un punto elevado. Desde allí, por un instante, puede uno aclarar con la imaginación la selva y restaurar un pequeño enclave maya en todo su esplendor.

La selva que rodea Chan Chich no sólo es rica en restos arqueológicos, sino también en fauna. Uno puede contemplar tapires adultos irguiendo su corta trompa mientras vigilan a sus pequeñas crías de pelaje manchado, y admirar el brillante plumaje del pavo ocelado, especialmente el de los machos, con su llamativa cabeza azul cubierta de pequeñas verrugas rojas. Por la noche, dirigiendo una linterna a lo alto de los árboles, se pueden descubrir kinkajúes de grandes ojos agarrados a las ramas con sus colas prensiles.

Toda mi vida he sido un apasionado de la ornitología, y me resulta especialmente placentero registrar las voces de los pájaros ocultos en la selva y reproducir sus cantos o llamadas para atraerlos y observarlos de cerca (aparte de grabarlos mejor). Un día de finales de diciembre me hallaba paseando en busca de pájaros por un sendero solitario cerca de Chan Chich.

En un principio mi paseo resultó infructuoso. No pude ver ni grabar ninguna de las aves que buscaba y, tras más de una hora de camino, ya no prestaba atención a los cantos de los pájaros ni a los movimientos en el follaje. Mis pensamientos habían derivado hacia la disciplina que ha ocupado buena parte de mi v ida profesional: la mecánica cuántica.

Durante la mayor parte de mi carrera como físico teórico mis investigaciones han versado sobre partículas elementales, las piezas básicas que constituyen toda la materia del universo. A diferencia de los físicos de partículas experimentales, no tengo necesidad de tener al lado un gigantesco acelerador o un laboratorio subterráneo para llevar a cabo mi trabajo. No hago un uso directo de complejos detectores y no requiero, por tanto, de la colaboración de un gran equipo de profesionales. Como mucho necesito lápiz, papel y una papelera, y muchas veces ni siquiera eso. Dadme un sueño reparador, un entorno sin distracciones y liberadme por un tiempo de preocupaciones y obligaciones y podré trabajar. Ya sea en la ducha, o en un vuelo nocturno, suspendido en la penumbra entre la vigilia y el sueño, o paseando por un sendero solitario, mi trabajo puede acompañarme dondequiera que vaya.

La mecánica cuántica no es en sí misma una teoría; es más bien el marco en el que debe encajar toda teoría física moderna. Este marco, como es bien sabido, implica el abandono del determinismo que caracterizaba a la física «clásica», dado que la mecánica cuántica sólo permite, por principio, el cálculo de probabilidades. Los físicos saben cómo emplearla para predecir las probabilidades de los resultados posibles de un experimento, y desde su descubrimiento en 1924 siempre ha funcionado a la perfección dentro de los límites de la teoría y el experimento considerados en cada caso. Sin embargo, pese a que su exactitud está fuera de toda duda, aún no comprendemos en profundidad su significado, especialmente cuando se aplica a la totalidad del universo. Durante más de treinta años, unos cuantos físicos teóricos hemos intentado elaborar lo que yo llamo «la interpretación moderna» de la mecánica cuántica, que permite aplicar esta disciplina al universo y tratar también con sucesos particulares que impliquen objetos individuales, en lugar de restringirse a experimentos repetibles sobre porciones de materia fácilmente reproducibles. Mientras caminaba por la selva cerca de Chan Chich, meditaba sobre el modo en que la mecánica cuántica puede emplearse, en principio, para tratar con la individualidad, para describir qué pieza de fruta se comerán los loros o las diversas formas en que un árbol en crecimiento puede hacer añicos las piedras de un templo en ruinas.

El hilo de mis pensamientos se rompió cuando, a unos cien metros de distancia, apareció ante mí una figura oscura. Me detuve y levanté lentamente mis binoculares para verla con más detalle. Resultó ser un jaguarondi, un felino de tamaño medio. Estaba parado en medio del camino, de perfil y con la cabeza vuelta hacia mí, lo que me permitió observar el característico cráneo aplastado, el cuerpo alargado y las cortas patas delanteras —rasgos que le han valido también el nombre de «gato nutria»—. Su longitud, aproximadamente un metro, y el color del pelaje —un gris oscuro uniforme, casi negro— indicaban que se trataba de un ejemplar adulto de la variedad oscura (hay otra variedad rojiza). Imagino que llevaba allí un buen rato, con sus ojos parduscos fijos en mí mientras yo, absorto en los misterios de la mecánica cuántica, me acercaba a él. Aunque es de suponer que estaba preparado para huir ante el menor peligro, el animal parecía completamente tranquilo. Nos observamos mutuamente, inmóviles los dos, durante lo que me parecieron varios minutos. No se movió ni siquiera cuando me aproximé a sólo unos treinta metros de distancia. Luego, satisfecha su curiosidad sobre mi persona, el felino volvió la mirada hacia la jungla, bajó la cabeza y desapareció lentamente entre los árboles.

Una visión como ésta es poco frecuente. El jaguarondi es un animal tímido y, debido a la destrucción de sus hábitats naturales en México, Centroamérica y América del Sur, su número ha decrecido en los últimos años; en la actualidad figura en la Lista roja de animales amenazados. Por otra parte, esta criatura es, por lo visto, incapaz de reproducirse en cautividad. Mi experiencia con aquel jaguarondi en particular entró en resonancia con mis ideas sobre la noción de individualidad, y me hizo recordar otro encuentro anterior en la naturaleza.

Un día de 1956, siendo un muy joven profesor en Caltech, mi primera esposa Margaret y yo, casados hacía muy poco, viajábamos en nuestro descapotable de regreso a Pasadena desde la Universidad de California en Berkeley, donde yo había impartido algunos seminarios de física teórica. En aquellos días los profesores universitarios vestíamos de modo un poco más formal que ahora —yo llevaba un traje de franela gris y Margaret una falda y un suéter, con medias y zapatos de tacón alto—. Circulábamos por la carretera 99 (que aún no se había convertido en autopista) a la altura de Tejón Pass, entre Bakersfíeld y Los Angeles. Siempre que pasábamos por aquella zona yo solía mirar al cielo con la esperanza de ver un cóndor de California. Esta vez divisé una silueta de gran tamaño volando a baja altura sobre nosotros, que desapareció rápidamente tras una colina situada a nuestra derecha. Como no estaba seguro de lo que era, resolví averiguarlo. Aparqué rápidamente al lado de la carretera, cogí mis prismáticos, salí del coche y trepé por la colina, hundiéndome a cada paso en la gruesa capa de fango rojo que cubría la mayor parte del sendero. A mitad de camino miré atrás y vi a Margaret no lejos de mí, con su elegante atuendo tan cubierto de barro como el mío. Alcanzamos juntos la cima y, al mirar hacia abajo, vimos un terreno en el que yacía un ternero muerto. Sobre él, en pleno festín, había once cóndores de California, casi la totalidad de la población de la especie en aquella época. Estuvimos observando un buen rato cómo comían, volaban un poco, se posaban de nuevo, paseaban alrededor del cadáver y volvían a comer. Yo ya sabía de su enorme tamaño (unos tres metros de envergadura), su cabeza pelada brillantemente coloreada y su plumaje blanco y negro. Lo que me llamó la atención fue el hecho de que se podían distinguir unos de otros por las plumas que les faltaban. Uno había perdido un par de plumas remeras del ala izquierda, otro tenía una muesca en forma de cuña en la cola, y ninguno tenía el plumaje intacto del todo. El efecto era bastante chocante: cada ave era de hecho un individuo fácilmente identificable, siendo sus señas de identidad el resultado directo de accidentes históricos. Me pregunté si aquellas pérdidas de plumaje eran permanentes, consecuencia de una vida larga y azarosa, o temporales, resultado simplemente de la muda anual (más tarde supe que los cóndores renuevan por completo su plumaje cada año). Aunque estamos acostumbrados a pensar en los seres humanos (y en nuestro perro o nuestro gato) como individuos, la visión de aquellos cóndores fácilmente reconocibles reforzó poderosamente mi apreciación de hasta qué punto percibimos el mundo como compuesto de objetos individuales, animados o no, cada uno con su historia particular.

Treinta años más tarde, en la selva centroamericana, contemplando el lugar por donde había desaparecido el jaguarondi, mientras rememoraba los desaliñados cóndores y recordaba que justo antes había estado meditando sobre historia e individualidad en mecánica cuántica, comprendí de repente que mis dos mundos, el de la física fundamental y el de los cóndores, los jaguarondis y las ruinas mayas, se habían unido al fin.

He vivido durante décadas entre dos pasiones intelectuales, por una parte mi labor profesional, en la que trato de comprender las leyes universales que gobiernan los constituyentes últimos de toda la materia, y por otra parte mi vocación de estudiante aficionado de la evolución de la vida y la cultura humana. Siempre tuve la impresión de que, de alguna forma, ambas pasiones estaban íntimamente ligadas, pero durante mucho tiempo fui incapaz de descubrir cómo (a excepción del tema común de la belleza de la naturaleza).

Parece que haya un enorme vacío entre la física fundamental y mis otros pasatiempos. En la física de partículas elementales tratamos con entes como los fotones y los electrones, cada uno de los cuales se comporta exactamente de la misma forma dondequiera que estén en el universo. De hecho, todos los electrones son rigurosamente intercambiables, igual que los fotones. Las partículas elementales no tienen individualidad.

Suele pensarse que las leyes de la física de partículas son exactas, universales e inmutables (dejando de lado posibles consideraciones cosmológicas), a pesar de que los físicos las abordamos a través de aproximaciones sucesivas. Por contra, disciplinas tales como la arqueología, la lingüística y la historia natural se ocupan de imperios, lenguajes y especies individuales, y en una escala más reducida, de artefactos, palabras y organismos individuales, incluyendo los propios seres humanos. En estas disciplinas las leyes son aproximadas, y tratan de la historia y de la evolución que experimentan las especies biológicas, los lenguajes humanos o las culturas.

Ahora bien, las leyes mecanocuánticas fundamentales de la física ciertamente dan lugar a la individualidad. La evolución física del universo, regida por dichas leyes, ha producido objetos particulares diseminados por todo el cosmos, como nuestro propio planeta, y después, a través de procesos como la evolución biológica en la Tierra, las mismas leyes han dado lugar a objetos particulares como el jaguarondi y los cóndores, capaces de adaptarse y aprender, y, por último, objetos particulares como los seres humanos, capaces de desarrollar el lenguaje y la civilización y de descubrir esas mismas leyes físicas fundamentales.

Durante algunos años mi trabajo estuvo dedicado a esta cadena de relaciones tanto como a las propias leyes fundamentales. Estuve pensando, por ejemplo, en la distinción entre los sistemas complejos adaptativos, que experimentan procesos como el aprendizaje y la evolución biológica, y los sistemas que, como las galaxias o las estrellas, experimentan otros tipos de evolución no adaptativa. Algunos ejemplos de sistemas complejos adaptativos pueden ser un niño aprendiendo su lengua materna, una cepa de bacterias volviéndose resistente a un determinado antibiótico, la comunidad científica comprobando la validez de una nueva teoría, un artista desarrollando su creatividad, una sociedad adoptando nuevas costumbres o nuevas supersticiones, un ordenador programado para elaborar nuevas estrategias para ganar al ajedrez o el género humano, buscando nuevas maneras de vivir en mayor armonía consigo mismo y con el resto de organismos con los que comparte el planeta.

La investigación de estos sistemas y de sus propiedades comunes, así como el trabajo sobre la interpretación moderna de la mecánica cuántica y sobre el significado de la simplicidad y la complejidad, había experimentado notables progresos. Para favorecer el estudio interdisciplinario de estas materias, yo mismo había colaborado en la fundación del Instituto de Santa Fe en Nuevo México.

Mi encuentro con el jaguarondi en Belice reforzó mi conciencia de los progresos que mis colegas y yo habíamos hecho en la mejor comprensión de las relaciones entre lo simple y lo complejo, entre lo universal y lo individual, entre las leyes básicas de la naturaleza y los asuntos individuales y mundanos que siempre me habían atraído.

Cuanto más aprendía acerca del carácter de esas relaciones, con más vehemencia deseaba comunicárselo a otros. Por primera vez en mi vida, sentí la necesidad de escribir un libro.

El título de este libro está inspirado en un poema de mi amigo Arthur Sze, un espléndido poeta chinoamericano que vive en Santa Fe y que conocí a través de su esposa Ramona Sakiestewa, una tejedora hopi de gran talento. Como lo expresa él, «el mundo del quark lo tiene todo para dar cuenta de un jaguar caminando en círculo en la noche».

Los quarks son las partículas elementales que constituyen el núcleo atómico. Soy uno de los dos teóricos que predijo su existencia, y fui yo quien les puso nombre. En el título, el quark simboliza las leyes físicas básicas y simples que gobiernan el universo y toda la materia que éste contiene. Sé que para mucha gente el calificativo de «simple» no es precisamente el que mejor define la física contemporánea, pero explicar cómo debe entenderse esta simplicidad es uno de los objetivos de este libro.

El jaguar representa la complejidad del mundo que nos rodea, especialmente tal como se manifiesta en los sistemas complejos adaptativos. La imagen de Arthur del quark y el jaguar transmite perfectamente mi idea de lo simple y lo complejo: de un lado, las leyes físicas subyacentes de la materia y el universo, y del otro, el rico entramado del mundo que percibimos directamente y del que formamos parte. Así como el quark es un símbolo de las leyes físicas que, una vez descubiertas, aparecen diáfanas ante el ojo analítico de la mente, el jaguar es, al menos para mí, una metáfora de los esquivos sistemas complejos adaptativos que continúan eludiendo una visión analítica clara, aunque su olor acre puede sentirse en la espesura. Ahora bien, ¿cómo surgió en mi niñez la fascinación por disciplinas como la historia natural, y cómo y por qué decidí finalmente hacerme físico?

Un niño curioso

Una gran parte de mi formación temprana se la debo a mi hermano Ben, nueve años mayor que yo. Fue él quien, cuando yo tenía tres años, me enseñó a leer (en la tapa de una caja de galletas) y me inició en la observación de aves y mamíferos, la botánica y el coleccionismo de insectos. Vivíamos en Nueva York, la mayor parte del año en Manhattan, pero incluso allí podía observarse la naturaleza. Pasábamos mucho tiempo en un bosquecillo de coníferas justo al norte del zoo del Bronx, lo poco que quedaba de un antiguo bosque que en el pasado debía abarcar toda el área urbana. Fragmentos de otros hábitats pervivían en lugares como las lagunas de Van Cortland Park, la playa y marismas de New Dorp, en Staten Island, e incluso Central Park, al lado de casa, donde podían verse algunas aves interesantes, especialmente durante las migraciones de primavera y otoño.

En estos lugares pude experimentar la diversidad de la naturaleza y el modo fascinante en que ésta se organiza. Si uno camina por la orilla de un pantano y ve un gorjeador o escucha su canto, sabe que lo más probable es que descubra otro poco después. Si uno desentierra un fósil, es probable que tropiece con otro parecido en las proximidades. Siendo ya físico me devanaba los sesos intentando averiguar el papel de las leyes físicas fundamentales en tales situaciones. La respuesta tiene que ver con el papel de la historia en la mecánica cuántica, y la explicación última reside en el estado primigenio del universo. Pero, dejando aparte cuestiones físicas tan profundas, el tema, menos abstruso, de la especiación como fenómeno biológico merece una consideración aparte.

La existencia de cosas tales como las especies no es en absoluto trivial. No son, como se ha dicho a veces, artefactos de la mente del biólogo. El gran ornitólogo y biogeógrafo Ernst Mayr suele contar cómo, al principio de su carrera, identificó ciento veintisiete especies entre las aves que nidificaban en un valle de Nueva Guinea. Los nativos del lugar distinguían ciento veintiséis; la única discrepancia era que ellos no diferenciaban entre dos especies del género Gerygone, muy similares, que Ernst sí podía discernir gracias a su adiestramiento como naturalista. Pero más importante todavía que el grado de concordancia entre gentes de distinta procedencia es el hecho de que las mismas aves pueden decirnos si pertenecen o no a la misma especie. Los animales de especies distintas no suelen aparearse entre sí y, en los raros casos en que esto sucede, los híbridos que resultan suelen ser estériles. De hecho, una de las mejores definiciones de especie es aquélla que establece que entre miembros de especies diferentes no existe, por los medios ordinarios, un intercambio efectivo de genes.

En mis primeros paseos por la naturaleza me llamaba la atención el hecho de que, ciertamente, las mariposas, aves y mamíferos que veía podían asignarse netamente a alguna especie. En un paseo por el campo uno puede ver gorriones canoros, gorriones de los pantanos, gorriones campestres y gorriones gorgiblancos, pero no verá ningún gorrión que se halle entre dos de estas categorías. Las disputas sobre si dos poblaciones pertenecen o no a la misma especie suelen surgir cuando se trata de poblaciones separadas en el espacio o bien en el tiempo, con al menos una de ellas representada en el registro fósil. A Ben y a mí nos gustaba discutir sobre las relaciones evolutivas entre las especies, que son como las ramas de un árbol evolutivo cuya estructura queda representada por los agolpamientos posibles en géneros, familias y órdenes. Cuanto más distante es el parentesco entre dos especies más abajo hay que ir en el árbol para encontrar un antecesor común.

Ben y yo no pasábamos todo el tiempo al aire libre. También visitábamos museos de arte, con especial predilección por los que incluían abundante material arqueológico (como el Metropolitan Museum of Art) u objetos de la Europa medieval (como el museo Cloisters). Leíamos libros de historia y aprendimos a descifrar algunas inscripciones egipcias. Nos entreteníamos estudiando la gramática latina, francesa y española, y caímos en la cuenta de que muchas palabras del francés y el español (así como muchas de las palabras que el inglés ha tomado prestadas) derivaban del latín. Las lecturas acerca de la familia de las lenguas indoeuropeas nos enseñaron que muchas palabras inglesas, latinas o griegas tenían un origen común, con leyes de transformación regulares. Por ejemplo, la palabra «sal» (salí en inglés) corresponde a sal en latín y a halos en griego, mientras que la palabra «seis» (six en inglés) corresponde a s'ex en latín y a hex en griego; la letra s inicial del inglés y el latín deriva de un sonido griego indicado con la letra h y consistente en una exhalación rápida. Aquí tenemos otro árbol evolutivo, esta vez aplicable a las lenguas.

Los procesos históricos, los árboles evolutivos, la diversidad organizada y la variabilidad individual se encontraban por doquier. Nuestra exploración de la diversidad también nos hizo ver que en muchos casos ésta se encontraba en peligro. Ben y yo fuimos conservacionistas precoces. Contemplábamos cómo las escasas áreas alrededor de Nueva York que se mantenían en un estado más o menos natural se iban reduciendo y los pantanos, por ejemplo, eran desecados y urbanizados.

Ya en la década de los treinta habíamos adquirido una aguda conciencia de la finitud del planeta, de la degeneración de las comunidades vegetales y animales a causa de la actividad humana y de la importancia del control demográfico, así como de la conservación del suelo, de la protección de los bosques y cosas por el estilo. Naturalmente, la necesidad de estas reformas aún no estaba ligada en mi pensamiento con la evolución, a escala planetaria, de la sociedad humana hacia una sociedad más sostenible, aunque así es como lo veo ahora. Aun así, ya entonces especulaba sobre el futuro de la especie humana, especialmente estimulado por las novelas y cuentos de ciencia ficción de H.G. Wells, que me encantaba leer.

También devoraba libros de cuentos y, junto con Ben, leía antologías de poesía inglesa. De vez en cuando íbamos a algún concierto, incluso a la ópera, pero éramos muy pobres y casi siempre teníamos que contentamos con actividades que no costasen dinero. Hicimos algunas tentativas de tocar el piano y de cantar arias y canciones de Gilbert y Sullivan. Escuchábamos la radio buscando emisoras lejanas, tanto de onda larga como corta, y cuando conseguíamos sintonizar una escribíamos para que nos enviasen una tarjeta postal. Recuerdo vívidamente las de Australia, con imágenes del pájaro cucaburra.

Ben y yo ansiábamos comprender el mundo y disfrutar de él, sin establecer divisiones arbitrarias. No distinguíamos entre las ciencias naturales, las ciencias sociales y del comportamiento, las humanidades o las artes. De hecho, nunca he creído en la primacía de tales distinciones. Lo que siempre me ha llamado la atención es la unidad de la cultura humana, donde la ciencia ocupa una parte importante. Incluso la distinción entre naturaleza y cultura humana es poco nítida, pues hay que recordar que también nosotros somos parte de la naturaleza.

La especialización, aunque no deja de ser un rasgo necesario de nuestra civilización, debe complementarse con la integración a través del pensamiento interdisciplinario. Uno de los obstáculos que siguen oponiéndose a dicha integración es la línea divisoria entre los que se sienten cómodos con las matemáticas y los que no. Yo tuve la fortuna de poder ejercitar el razonamiento cuantitativo desde una edad temprana.

Aunque a Ben también le interesaban la física y las matemáticas, fue mi padre quien más me animó a estudiar ambas cosas. Inmigrante austrohúngaro, a principios de siglo interrumpió sus estudios en la Universidad de Viena para trasladarse a Estados Unidos y reunirse con sus padres, que habían emigrado unos años antes a Nueva York y tenían problemas para salir adelante. El primer trabajo de mi padre fue en un orfanato de Filadelfia, donde aprendió a hablar inglés y a jugar al béisbol. Aunque su adopción de la lengua inglesa fue tardía, la hablaba perfectamente, sin errores gramaticales ni fonéticos. Sólo podía adivinarse que era extranjero precisamente porque nunca cometía errores.

En los años veinte, después de ejercer unos cuantos trabajos, abrió la Arthur Gell-Mann School of Languages, donde enseñaba a otros inmigrantes a hablar un inglés impecable. También daba clases de alemán y contrató profesores de francés, español, italiano y portugués. La escuela tuvo cierto éxito, pero en 1929, el año en que nací yo, las cosas comenzaron a cambiar. No sólo se produjo la quiebra de la bolsa, sino que entró en vigor una severa ley de restricción de la inmigración. El número de alumnos potenciales de mi padre disminuyó por culpa de la nueva legislación y los que había se empobrecieron por culpa de la Depresión. Cuando yo tenía tres años, la escuela tuvo que cerrar y mi padre tuvo que emplearse en un banco para mantenernos, y crecí pensando en los viejos y buenos tiempos que no llegué a conocer.

Mi padre estaba interesado en las matemáticas, la física y la astronomía, y cada día podía pasarse horas encerrado en su estudio absorto en los libros sobre relatividad especial y general y sobre la expansión del universo. Fue él quien despertó mi interés por las matemáticas, que con el tiempo llegarían a apasionarme y admirarme por su coherencia y rigor.

En mi último año de bachillerato, a la hora de rellenar la solicitud de ingreso en Yale, tenía que decidir qué estudios quería cursar. Mi padre, con quien consulté la cuestión, no ocultó su desdén ante mi intención de estudiar arqueología o lingüística, argumentando que me moriría de hambre, y me propuso estudiar ingeniería, a lo que repliqué que, aparte de pasar más hambre todavía, cualquier ingenio que yo diseñase probablemente acabaría desmoronándose (más adelante, como resultado de un test de aptitud, se me recomendó «¡cualquier cosa menos ingeniería!»). Así que, como solución de compromiso, mi padre me propuso estudiar física.

Le dije que mis notas de física habían sido las peores de todo el bachillerato y que era la única asignatura que me había ido mal; que habíamos tenido que memorizar cosas como las siete máquinas simples: la palanca, el tomo, el plano inclinado y cosas por el estilo; que habíamos estudiado mecánica, calor, sonido, luz, electricidad y magnetismo, pero sin ninguna conexión entre los temas.

Mi padre pasó entonces de los argumentos económicos a los intelectuales y estéticos. Me aseguró que la física avanzada me resultaría mucho más interesante y satisfactoria que la del bachillerato, y que me apasionarían la relatividad y la mecánica cuántica. Decidí complacerlo a sabiendas de que podría cambiar de carrera cuando llegase a New Haven. Pero una vez allí desaparecieron las ganas de cambiar, y al cabo de poco tiempo ya estaba enganchado y comenzaba a disfrutar de la física teórica. Mi padre tenía razón en lo referente a la relatividad y la mecánica cuántica. A medida que las estudiaba iba comprendiendo que la belleza de la naturaleza se manifestaba tanto en la elegancia de sus principios como en el grito de un colimbo o en las estelas bioluminiscentes que dejan las marsopas en la noche.

Sistemas complejos adaptativos

Un maravilloso ejemplo de esa simplicidad en los principios de la naturaleza es la ley de la gravedad, y en concreto la teoría de la gravitación formulada en la relatividad general de Einstein (aunque para la mayoría de la gente esta teoría es cualquier cosa menos simple). En el curso de la evolución física del universo, el fenómeno de la gravitación dio origen a la agregación de la materia en galaxias y más tarde en estrellas y planetas, entre ellos nuestra Tierra. Desde el mismo momento de su formación, tales cuerpos ya manifestaban una cierta complejidad, diversidad e individualidad, pero estas propiedades adquirieron un nuevo significado con la aparición de los sistemas complejos adaptativos. En la Tierra este hecho estuvo ligado a los procesos del origen de la vida y la evolución biológica, que han generado la gran diversidad de especies existente. Nuestra propia especie, que al menos en algunos aspectos es la más compleja de las que han evolucionado hasta ahora en este planeta, ha llegado a descubrir gran parte de la simplicidad subyacente, incluyendo la teoría de la gravitación misma.

La investigación en las ciencias de la complejidad, tal como se desarrolla en el Instituto de Santa Fe y en cualquier parte del mundo, no sólo intenta desentrañar el significado de lo simple y lo complejo, sino también las semejanzas y diferencias entre los sistemas complejos adaptativos implicados en procesos tan diversos como el origen de la vida, la evolución biológica, la dinámica de los ecosistemas, el sistema inmunitario de los mamíferos, el aprendizaje y los procesos mentales en los animales (incluido el hombre), la evolución de las sociedades humanas, el comportamiento de los inversores en los mercados financieros y el empleo de programas y/o equipos informáticos diseñados para desarrollar estrategias o hacer predicciones basadas en observaciones previas.

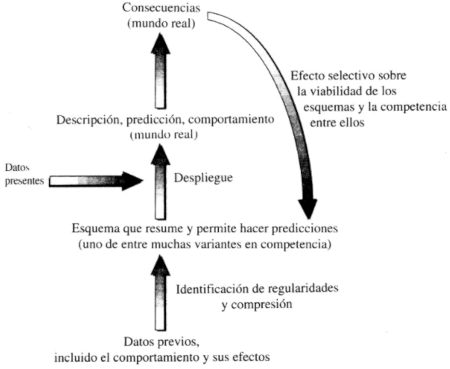

Lo que tienen en común todos estos procesos es la existencia de un sistema complejo adaptativo que adquiere información acerca tanto de su entorno como de la interacción entre el propio sistema y dicho entorno, identificando regularidades, condensándolas en una especie de «esquema» o modelo y actuando en el mundo real sobre la base de dicho esquema. En cada caso hay diversos esquemas en competencia, y los resultados de la acción en el mundo real influyen de modo retroactivo en dicha competencia.

En muchos aspectos, cada uno de nosotros funciona como un sistema complejo adaptativo (de hecho, el término «esquema» se emplea desde hace tiempo en psicología para referirse a una estructura conceptual de la que el ser humano hace uso para comprender un conjunto de datos, para darle sentido).

Imaginemos que estamos en una ciudad extraña a una hora punta de la tarde intentando coger un taxi en una concurrida avenida que parte del centro. Vemos que los taxis pasan de largo sin pararse, muchas veces porque ya están ocupados, y nos percatamos de que en ese caso la luz del techo está apagada. ¡Aja! Hay que fijarse en los taxis con la luz del techo encendida. Entonces descubrimos que hay taxis que, a pesar de llevar esa luz encendida y no llevar pasajeros, tampoco paran. Hay que modificar el esquema. Pronto nos percatamos de que la luz del techo consta de una parte interna y una externa en donde puede leerse «fuera de servicio». Lo que necesitamos es un taxi que lleve encendida sólo la parte interna. Nuestra nueva idea se confirma cuando a una manzana de distancia vemos dos taxis que, tras dejar a sus pasajeros, encienden únicamente la luz interna del techo. Pero estos taxis son inmediatamente ocupados por otros peatones. Unos cuantos más acaban su carrera a poca distancia, pero también son ocupados enseguida. Aquí nos sentimos impelidos a ampliar nuestra búsqueda de un esquema válido, hasta que observamos que en sentido contrario pasan muchos taxis con sólo la luz interna encendida. Cruzamos la avenida, paramos uno y subimos.

Como ilustración adicional, imaginemos que se nos somete a un experimento psicológico en el que se nos muestra una larga secuencia de imágenes de objetos familiares. Las imágenes representan cosas diversas, y cada una puede aparecer varias veces. Cada cierto tiempo se nos pide que adivinemos qué imágenes van a aparecer. Entonces construimos esquemas mentales de la secuencia, inventando teorías sobre la estructura de ésta basadas en las imágenes que hemos visto antes. Cualquiera de estos esquemas, suplementado con la memoria de las últimas imágenes mostradas, nos permite hacer predicciones. Lo normal es que estas predicciones comiencen siendo erróneas, pero si la secuencia tiene una estructura fácil de captar, la discrepancia entre predicción y observación hará que los esquemas erróneos sean descartados en favor de otros mejores y pronto podremos prever con precisión cuál será la próxima imagen.

Imaginemos ahora un experimento similar ejecutado por un psicólogo sádico que nos muestra una secuencia sin estructura alguna. Probablemente continuaríamos elaborando esquemas fallidos que sólo acertarán de vez en cuando por puro azar. En este caso, los resultados en el mundo real no proporcionan ninguna guía para la elección de otro esquema que no sea «esta es una secuencia sin ton ni son». Pero a los seres humanos les cuesta aceptar una conclusión así.

Cuando alguien planea una nueva aventura comercial, mejora una receta o aprende un lenguaje, se está comportando como un sistema complejo adaptativo. Cuando uno adiestra un perro, está observando las acciones de un sistema complejo adaptativo y a la vez se está comportando como tal (si ocurre más lo segundo que lo primero, como suele ser el caso, es posible que sea el perro quien esté adiestrándole a uno). Cuando uno invierte en bolsa se convierte, junto con los otros inversores, en un sistema complejo adaptativo que forma parte de una entidad colectiva en evolución a través de los esfuerzos de todos sus componentes para mejorar su posición o, por lo menos, para sobrevivir económicamente. Tales entidades colectivas organizadas, del tipo de una empresa o una tribu, constituyen sistemas complejos adaptativos en sí mismas. La humanidad en conjunto no está aún demasiado bien organizada, pero en un grado considerable ya funciona también como un sistema complejo adaptativo.

El aprendizaje en su sentido habitual no es el único ejemplo de sistema complejo adaptativo. La evolución biológica proporciona muchos otros. Mientras que los seres humanos adquieren conocimiento principalmente a través del uso individual o colectivo de su cerebro, en los otros animales la herencia genética es responsable de una fracción mucho mayor de la información necesaria para la supervivencia; esta información, fruto de millones de años de evolución, subyace en lo que, de modo bastante vago, suele denominarse «instinto». Las mariposas monarca nacidas en diferentes lugares de los Estados Unidos «saben» emigrar hasta las laderas cubiertas de coníferas de los volcanes mejicanos, donde se concentran en gran número para pasar el invierno. Isaac Asimov, el conocido ex bioquímico, divulgador científico y escritor de ciencia ficción, me contó que en cierta ocasión mantuvo un debate público con un físico teórico que negaba que un perro tuviese conocimiento de las leyes del movimiento de Newton. Indignado, Isaac le preguntó si seguiría pensando lo mismo después de ver a un perro atrapando al vuelo un plato de plástico con la boca. Es obvio que la palabra «conocimiento» no tenía el mismo significado para ambos. Para el físico sería el resultado de un aprendizaje en el contexto cultural de la empresa científica humana; para Isaac sería el fruto de la evolución biológica a través de la información inscrita en los genes, suplementada con algo de aprendizaje basado en la experiencia.

También es la evolución biológica la que ha hecho surgir en los organismos la capacidad de aprender, ya sea en los paramecios, los perros o las personas. Asimismo, este proceso ha dado lugar a otras formas de sistema complejo adaptativo. Un ejemplo es el sistema inmunitario de los mamíferos, donde tienen lugar procesos muy similares a los de la evolución biológica, pero a una escala temporal de horas o días en lugar de millones de años. Tales procesos permiten identificar a tiempo los organismos invasores o las células extrañas y producir la oportuna respuesta inmunitaria.

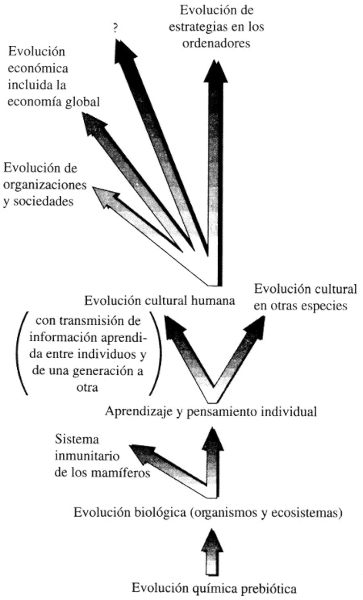

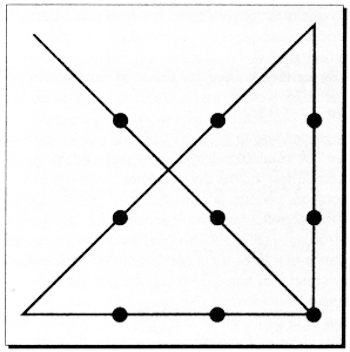

Los sistemas complejos adaptativos muestran una tendencia general a generar otros sistemas de la misma categoría. La evolución biológica, por ejemplo, puede conducir tanto a soluciones «instintivas» de los problemas que debe afrontar un organismo como al desarrollo de una inteligencia suficiente para resolver los mismos problemas mediante el aprendizaje. El diagrama de la página siguiente ilustra las relaciones entre diversos sistemas complejos adaptativos terrestres. Hace unos cuatro mil millones de años, determinadas reacciones químicas que incluían algún mecanismo de reproducción y de transmisión de las variaciones condujeron a la aparición de la primera forma de vida y después a los diversos organismos que constituyen las comunidades ecológicas. Más tarde la vida originó nuevos sistemas complejos adaptativos, como el sistema inmunitario y los procesos de aprendizaje. En los seres humanos el desarrollo de la capacidad para el lenguaje simbólico convirtió el aprendizaje en una actividad cultural elaborada, y dentro de la cultura humana han surgido nuevos sistemas complejos adaptativos: sociedades, organizaciones, la economía o la ciencia, por citar unos cuantos. Ahora que la cultura humana ha creado ordenadores rápidos y poderosos, tenemos la posibilidad de hacer que actúen también como sistemas complejos adaptativos.

En el futuro la cultura humana puede dar lugar a nuevos sistemas complejos adaptativos. Un ejemplo, que ha sido tratado por la literatura de ciencia ficción, me llamó por primera vez la atención cuando, a principios de los cincuenta, el gran físico húngaro-norteamericano Leo Szilárd, ya retirado, nos invitó a un colega y a mí a asistir a un congreso internacional sobre control de armas. M i colega, «Murph» Goldberger (que sería presidente de Caltech y después director del Instituto de Estudios Avanzados de Princeton), replicó que sólo podría asistir a la segunda mitad del congreso; yo por mi parte respondí que sólo podría asistir a la primera mitad. Leo pensó un momento y después nos dijo: «No, no puede ser; vuestras neuronas no están interconectadas».

Es posible que algún día, para bien o para mal, tales interconexiones puedan llevarse a cabo. Un ser humano podría conectarse a un ordenador avanzado directamente (no a través de una consola o de la palabra) y a través de ese ordenador podría conectarse a otras personas. Los pensamientos y emociones podrían compartirse en su totalidad, no del modo selectivo y engañoso que permite el lenguaje. (Según una máxima atribuida a Voltaire, «los hombres... emplean el lenguaje sólo para disimular sus pensamientos».) Mi amiga Shirley Hufstedler dice que estar unidos por cables es algo que no recomendaría a una pareja a punto de casarse. Por mi parte no estoy seguro de que este procedimiento sea recomendable en ningún caso (aunque, si todo fuera bien, quizá podría aliviar algunos de los problemas humanos más intratables). Pero ciertamente crearía una nueva forma de sistema complejo adaptativo, un auténtico conglomerado de seres humanos.

Figura 1. Algunos sistemas complejos adaptativos del planeta Tierra

Los estudiosos de los sistemas complejos adaptativos comienzan a familiarizarse con sus propiedades generales y también con sus peculiaridades. Aunque difieren grandemente en sus características físicas, todos procesan información de algún modo. Este rasgo común es seguramente el mejor punto de partida para explorar su funcionamiento.

Capítulo 3

Información y complejidad

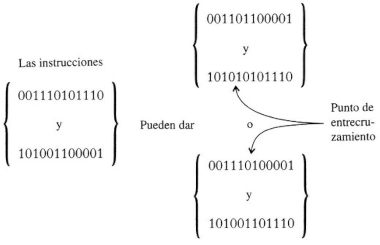

El estudio de cualquier sistema complejo adaptativo se concentra en la información, que llega al sistema en forma de un flujo de datos (por ejemplo, una secuencia de imágenes, mostradas a un sujeto en un experimento psicológico). Examinamos la manera en que el sistema percibe regularidades que extrae del flujo de datos separándolas de lo que es incidental o arbitrario y condensándolas en un esquema sujeto a variación (en el supuesto anterior, el sujeto crea y modifica continuamente leyes hipotéticas que se supone que gobiernan las regularidades encontradas en la secuencia de imágenes). Observamos cómo cada uno de los esquemas resultantes se combina entonces con información adicional, de la clase de la información incidental dejada de lado en la abstracción de regularidades a partir del flujo de datos, para generar un resultado aplicable al mundo real: la descripción de un sistema observado, la predicción de algún suceso o la prescripción del comportamiento del propio sistema complejo adaptativo. (En el experimento psicológico, el sujeto puede combinar un posible esquema basado en las imágenes anteriores con unas cuantas de las siguientes para hacer una predicción de las imágenes que saldrán a continuación. En este caso, como suele pasar, la información adicional procede de una porción posterior del mismo flujo de datos del que el esquema fue abstraído.) Finalmente, vemos qué efectos tiene dicha descripción, predicción o comportamiento en el mundo real; tales efectos son retroactivos, ejerciendo «presiones selectivas» sobre los esquemas en competencia, algunos de los cuales quedan desacreditados o descartados, mientras que otros sobreviven y prosperan. (En el ejemplo, un esquema predictivo contradicho por las imágenes subsiguientes presumiblemente será descartado por el sujeto, mientras que otro cuyas predicciones son correctas será conservado. Aquí el esquema se pone a prueba contrastándolo con una porción ulterior del mismo flujo de datos del que nació y del que se obtuvo la información adicional para hacer predicciones.) El funcionamiento de un sistema complejo adaptativo puede representarse en un diagrama como el de esta página, donde se hace hincapié en el flujo de información.

Figura 2. Funcionamiento de un sistema complejo adaptativo

Los sistemas complejos adaptativos se hallan sujetos a las leyes de la naturaleza, que a su vez se fundamentan en las leyes físicas de la materia y el universo. Por otra parte, la existencia de tales sistemas sólo es posible en condiciones particulares.

Para examinar el universo y la estructura de la materia podemos seguir la misma estrategia adoptada en el estudio de los sistemas complejos adaptativos: concentrarse en la información. ¿Cuáles son las regularidades y dónde entran la contingencia y la arbitrariedad?

Indeterminación cuántica y caótica

De acuerdo con la física decimonónica, el conocimiento exacto de las leyes del movimiento y de la configuración del universo en un momento dado permitiría, en principio, la predicción de la historia completa de éste. Ahora sabemos que esto es absolutamente falso. El universo es mecanocuántico, lo que implica que, aun conociendo su estado inicial y las leyes fundamentales de la materia, sólo puede calcularse un conjunto de probabilidades para las diferentes historias posibles. Por otra parte, esta «indeterminación» cuántica va mucho más allá de lo que suele creerse. Mucha gente conoce el principio de incertidumbre de Heisenberg, que prohíbe, por ejemplo, conocer simultáneamente con exactitud la posición y el momento de una partícula. Mientras que este principio ha sido ampliamente divulgado (a veces de manera francamente errónea) apenas se habla de la indeterminación adicional requerida por la mecánica cuántica. Más adelante volveremos sobre este tema.

Aunque la aproximación clásica esté justificada y, en consecuencia, pueda ignorarse la indeterminación mecanocuántica, todavía nos queda el extendido fenómeno del caos, en el que la evolución de un proceso dinámico no lineal es tan sensible a las condiciones iniciales que un cambio minúsculo en la situación al principio del proceso se traduce en una gran diferencia al final.

Algunas de las conclusiones contemporáneas sobre determinismo y caos en mecánica clásica ya fueron anticipados en 1903 por el matemático francés Henri Poincaré en su libro Ciencia y método (citamos por Ivars Peterson en Newton’s Clock [El reloj de Newton]):

«Si conociéramos con precisión infinita las leyes de la naturaleza y la situación inicial del universo, podríamos predecir exactamente la situación de este mismo universo en un momento posterior. Pero incluso aunque las leyes naturales no tuvieran ningún secreto para nosotros, sólo podríamos conocer la situación inicial de modo aproximado. Todo lo que necesitamos para poder decir que un fenómeno ha sido predicho y que está regido por leyes es poder predecir la situación posterior con la misma aproximación que la inicial. Pero esto no siempre es posible; puede ocurrir que las pequeñas diferencias en las condiciones iniciales se hagan muy grandes en el resultado final. Un pequeño error al principio producirá un error enorme al final. La predicción se hace imposible y tenemos un fenómeno fortuito.»

Uno de los artículos que llamaron la atención sobre el caos en los años sesenta fue publicado por el meteorólogo Edward N. Lorenz. De hecho, la meteorología es una fuente de ejemplos familiares de caos. Aunque las fotografías por satélite y el uso de potentes ordenadores han hecho que la predicción del tiempo sea absolutamente fiable para muchos propósitos, los partes meteorológicos todavía no pueden garantizarnos lo que mucha gente quiere saber: si lloverá o no aquí y mañana. Tanto el lugar exacto por donde pasará una tormenta como el momento en que descargará la lluvia pueden ser arbitrariamente sensibles a los detalles de los vientos y de la posición y estado físico de las nubes unos cuantos días o incluso unas horas antes. La más ligera imprecisión en los datos meteorológicos hace que uno no pueda fiarse de la previsión para mañana a la hora de planear una excursión.

Dado que nada puede medirse con una precisión absoluta, el caos da origen a una indeterminación efectiva en el nivel clásico que se superpone a la indeterminación cuántica. La interacción entre estas dos clases de impredictibilidad es un aspecto fascinante y todavía poco estudiado de la física contemporánea. El reto que supone comprender la relación entre la impredictibilidad de carácter cuántico y la de carácter caótico ha llegado incluso a llamar la atención de los editores de Los Angeles Times, tanto que en 1987 le dedicaron al tema un editorial en el que se señalaba la aparentemente paradójica incapacidad de los teóricos para encontrar la indeterminación de carácter caótico que debería aparecer superpuesta a la de carácter cuántico cuando se aplica la mecánica cuántica a sistemas que exhiben caos en el dominio clásico.

Pero la cuestión comienza a aclararse gracias al trabajo de diversos físicos teóricos, entre ellos Todd Brun, uno de mis discípulos. Sus resultados parecen indicar que, para muchos propósitos, es útil contemplar el caos como un mecanismo que amplifica a escala macroscópica la indeterminación inherente a la mecánica cuántica.

En los últimos tiempos se ha publicado un montón de artículos sobre caos escritos bastante a la ligera. Un término técnico, aplicado en principio a un fenómeno de la mecánica no lineal, ha acabado convirtiéndose en una especie de etiqueta para designar cualquier clase de complejidad o incertidumbre, real o aparente. Si en alguna de mis conferencias sobre, digamos, sistemas complejos adaptativos, menciono el fenómeno aunque sólo sea una vez, y a veces ni eso, estoy seguro de que seré felicitado al final por mi interesante charla sobre «caos».

El impacto de los descubrimientos científicos en la literatura y la cultura popular tiende a traducirse en que ciertos elementos de vocabulario, interpretados de modo vago o erróneo, suelen ser lo único que sobrevive al viaje desde la publicación técnica a los libros y revistas populares. Los dominios de aplicación o las distinciones importantes, y a veces las propias ideas, tienden a perderse por el camino. Piénsese si no en los usos populares de palabras como «ecología» o «salto cuántico», y ya no digamos de la expresión New Age «campo de energía». Naturalmente, uno siempre puede argumentar que palabras como «caos» o «energía» ya existían antes de convertirse en términos técnicos, pero lo que resulta distorsionado en el proceso de vulgarización es precisamente su significado técnico, no el original.

Dada la eficacia creciente de las técnicas literarias en la transformación de conceptos útiles en tópicos huecos, hay que esmerarse si se quiere evitar que las diversas nociones de complejidad corran la misma suerte. Más adelante las detallaremos y examinaremos el dominio de aplicación de cada una de ellas.

Pero antes, ¿qué se entiende por «complejo» cuando hablamos de «sistema complejo adaptativo» en el sentido aquí empleado? De hecho, no hace falta que la palabra «complejo» tenga un significado preciso en esta frase, que es puramente convencional. Su presencia implica la convicción de que tales sistemas poseen un grado mínimo de complejidad convenientemente definido.

La simplicidad hace referencia a la ausencia (o casi) de complejidad. Etimológicamente, simplicidad significa «plegado una vez», mientras que complejidad significa «todo trenzado» (nótese que tanto «plic-» para pliegue como «plej-» para trenza derivan de la misma raíz indoeuropea plek).

Diferentes formas de complejidad

¿Qué se entiende realmente por simplicidad y complejidad? ¿En qué sentido es simple la gravitación einsteniana y complejo un pez de colores? No son cuestiones sencillas —no es simple definir «simple»—. Probablemente no existe un único concepto de complejidad que pueda captar adecuadamente nuestras nociones intuitivas. Puede que se requieran varias definiciones diferentes, algunas quizá todavía por concebir.

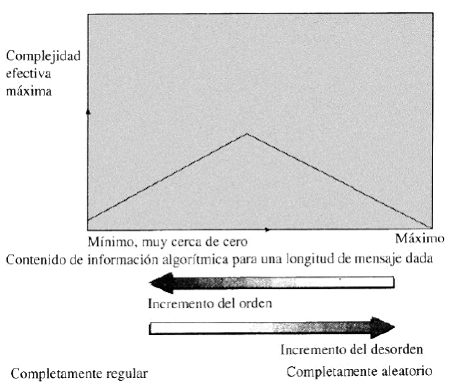

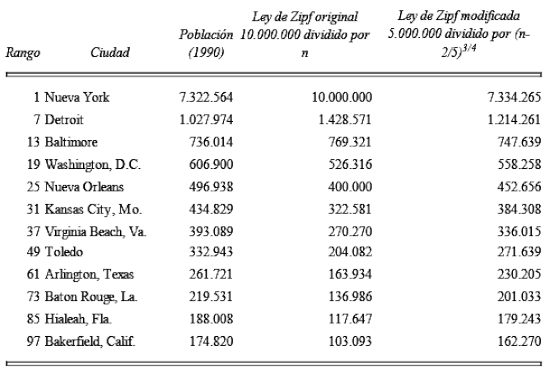

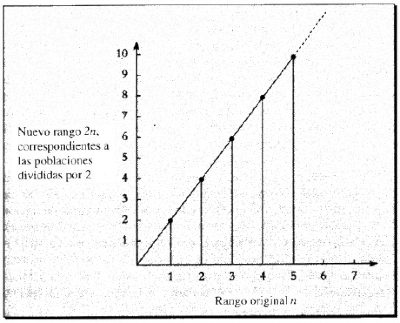

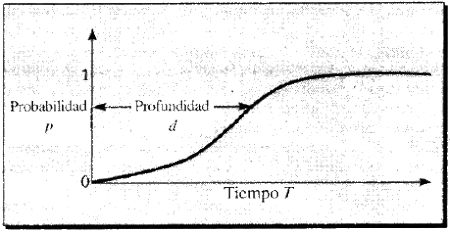

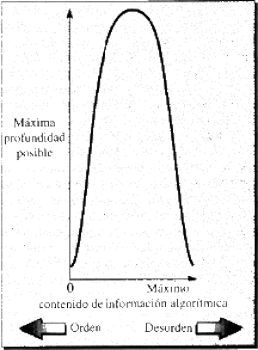

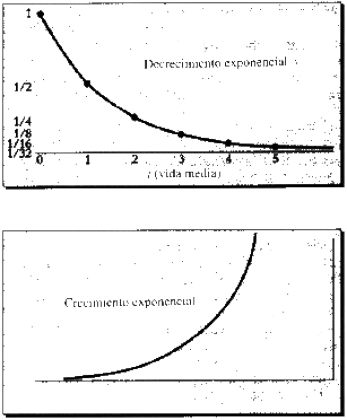

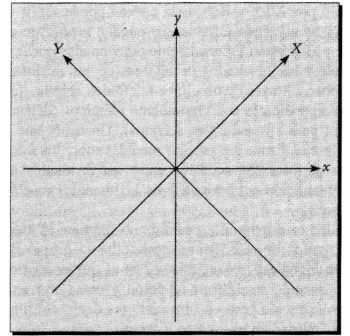

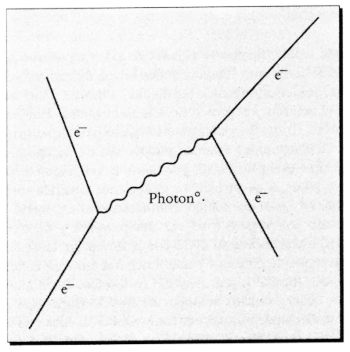

Una definición de complejidad surge de la ciencia informática, y tiene que ver con el tiempo requerido por un ordenador para resolver un problema determinado. Dado que este tiempo depende también de la competencia del programador, el que se toma en consideración es el más corto posible, lo que se conoce habitualmente como «complejidad computacional» del problema.